政府が大規模な人工知能(AI)開発者を対象とする法規制の検討に入ることが18日分かった。偽情報対策などに不備がある場合の罰則を視野に入れる。欧州連合(EU)をはじめとする各国・地域が強制力のある規制に動いているのを踏まえ、企業の自主的な取り組みを尊重してきた従来の方針を転換する。6月ごろに取りまとめる経済財政運営の指針「骨太方針」への明記を目指す。

AIによる偽情報の流布や人権侵害が問題となる中、AIを直接の対象とした拘束力のある規制が必要と判断した。

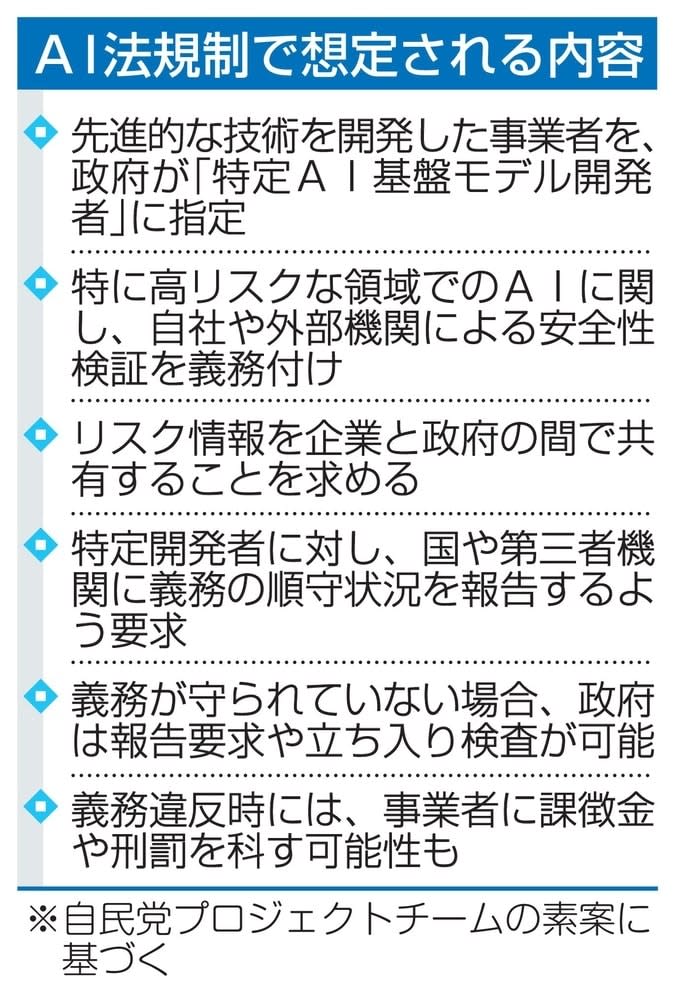

素案によると、対話型の生成AI「チャットGPT」の米オープンAIなどを念頭に、先進的な技術を開発した事業者を、政府が「特定AI基盤モデル開発者」に指定する。特に高リスクな領域でのAIに関しては、自社や外部機関による安全性検証を義務付け、リスク情報を企業と政府で共有することも求める。義務違反時には課徴金や刑罰を科す可能性もある。

EU欧州議会は3月、世界初の包括的なAI規制法案を可決した。違反時に巨額の制裁金を科す。2026年から適用する見通し。