GoogleやMicrosoftなども参入し、さらなる進化が期待されている「生成AI」。今後AIが仕事のいたる部分で導入されていくのは必至ですが、活用する上で見過ごせない“問題”があります。田中道昭氏の著書『生成AI時代 あなたの価値が上がる仕事』(青春出版社)より一部抜粋し、見ていきましょう。

事実に基づかない情報を生成する「幻覚」問題

生成AIを使って仕事をするとき、あるいはこれから本格的に生成AIを取り入れて仕事をしようと考えている企業などでは、見過ごせない問題がいくつかあります。まず、“幻覚”問題です。

幻覚というのは、生成AIが事実に基づかない情報を生成する現象で、ハルシネーションとも呼ばれています。ハルシネーションというのは、もともと精神医学の用語で、幻覚剤などによってもたらされる人間の幻覚や妄想といったものを指しています。

生成AIでも同じように、生成される回答にハルシネーションがあらわれます。生成AIは、実に膨大なデータで事前学習されています。ところが、学習したデータに誤りや偏りがあれば、これらのデータも生成AIは学習してしまいます。間違っていたり偏っていたりするデータで学習するのですから、生成AIの回答にもまた間違いが含まれるわけです。

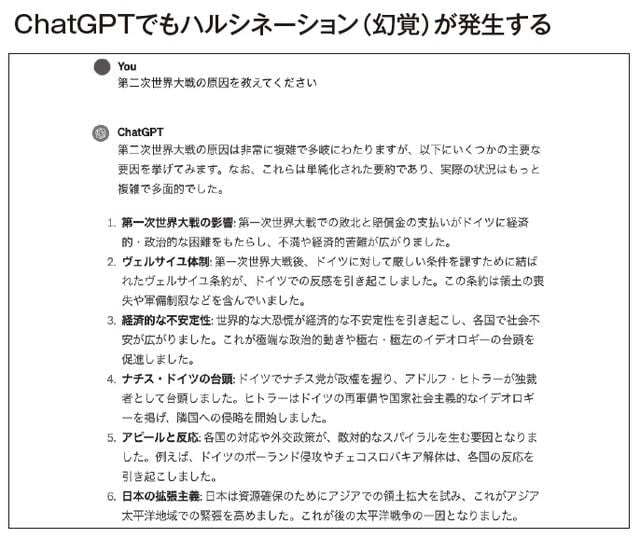

たとえば、「第二次世界大戦の原因を教えてください」と指示すると、要因はいくつかあり、それらは複雑で多岐に渡っているのですが、そのなかのひとつに「ユダヤ人の陰謀があります」などと、根拠のない回答をすることがあります【図表】。

【図表】ChatGPTでもハルシネーション(幻覚)が発生する

これらのハルシネーションは、回答そのものが間違っていたり、本来答えてはならない質問に回答したり、またそれらの回答に間違ったデータや事実が含まれることに大きな問題があります。この間違った回答をすぐに誤りだと見抜ければいいのですが、質問をした人間のほうが騙されるケースも少なくないのです。

生成AIを仕事に活用しようとするとき、指定した命令に誤った回答を生成してきたらどうでしょう。自社の製品のマーケティングについて質問したとき、間違った回答を返し、その回答を参考に販売戦略を立てたとすれば、大きな損失につながることだってあり得ます。これがハルシネーションの大きな問題です。

■ハルシネーションの対処法

ハルシネーションを回避するためには、AIが学習するデータに誤りや偏りがないよう管理し、データのソースを明確にする必要があります。必要なデータや特定のデータを事前に学習させることも、ハルシネーションを最小にするための方法のひとつです。チャットGPTでもすでにスタートしていますが、企業向けの生成AIを利用したり、事前にデータを読み込ませたりして自社向けにカスタマイズすることもできます。

それでもハルシネーションの被害は発生します。生成AIの回答にはハルシネーションが含まれるから、生成AIは利用しないという後ろ向きの取り組みではなく、生成AIにはハルシネーションのリスクがあることを利用者に徹底的に周知させ、生成AIの回答に含まれる幻覚を見破るための知識やノウハウを身につけることが重要なのです。

生成AIのハルシネーションを、完全に防ぐことは難しいのですが、リスクを知り、ハルシネーションを見破るノウハウを確立しておくことで、その被害を軽減することが可能になります。

著作権・肖像権の問題

もうひとつ、生成AIですでに問題になっているのが、著作権・肖像権の問題です。この問題には、2つの側面があります。

まず、生成AIの回答が、従来の著作物の著作権を侵害している可能性がある、という面です。たとえば、集英社で発行している青年向け雑誌の週刊プレイボーイでは、2023年5月に他社に先駆けて生成AIで作り出したアイドルのAIグラビア写真集「生まれたて。」を電子書籍として発行しました。

ところがこの写真集は、1週間ほどで販売終了となりました。発売後に多くの意見が寄せられたことから、「生成AIをとりまく論点・問題点の検討が十分でなかった」として販売中止の判断をしたようです。が、一説には写真集のモデルが実在の女性芸能人に似ているとの指摘が相次いだことから、肖像権の侵害につながるのではとの判断で、販売中止にしたのではないかとも見られています。

生成AI、この写真集では画像生成AIですが、これらの生成AIでは事前に膨大な量のデータを学習させ、このなかからユーザーの指示や命令にしたがってテキストや画像を生成しています。学習させたデータのなかには、すでに著作物として発表されているデータもあれば、実在のモデルの写真や絵画、イラストといったものも含まれるでしょう。

それらのデータを、AIが生成するコンテンツに利用されたとすれば、著作権や肖像権の侵害問題が出てくる可能性も高いのです。生成AIが作り出すコンテンツは、既存の著作物の複製や改変に該当する可能性があるわけです。

著作権の面ではもうひとつ、生成AIが作り出したコンテンツにも、著作権があるのかどうかという問題があります。

著作権法では、著作物とは「思想または感情を創作的に表現したもの」と定義されています。この定義からすれば、生成AIが作成したコンテンツも著作物に該当し、そのコンテンツの著作権は生成AIの開発者、あるいは生成AIを利用するユーザーに帰属する、という考え方もできるでしょう。

一方で、こうして作成されたコンテンツが、必ずしも創造性があるとは限らないケースも出てきます。

たとえば、生成AIに「100文字で詩を作ってください」と命令すると、既存の詩から学習して似たような詩を生成してしまう可能性があります。こうして作られた詩は、創造性があるとはいえないと判断される可能性があるわけです。

■生成AIと著作権の問題は、各国が対応を検討しはじめたばかり

生成AIという新しい技術が直面する問題だけに、現在はまだ生成AIと著作権に関して各国で対応を検討しはじめた段階です。たとえばEUでは23年6月に欧州議会で「AI法案(Artificial Intelligence Act)の修正案が可決され、以後生成AIについての規制創設を検討しています。

米国では、22年10月に「AI権利章典(AI Bill of Rights)」が公表され、AIを含む自動化されたシステムを開発する際の原則が公開されましたが、生成AIに関しては連邦議会で規制の必要性が議論されているところです。

日本では、23年5月に開催されたG7広島サミットで、AIに関する利活用の推進や規制に向けた国際ルールを検討することが確認され、内閣府のAI戦略会議が「AIに関する暫定的な論点整理」を公表。現在は総務省・経産省において、事業者向けのAIに関するガイドラインを改定した「新AI事業者ガイドライン」の検討が進められています。

生成AIの利用はまだ始まったばかりで、法整備が追いつかない状況です。実際に仕事やビジネスに活用するときは、これらの点に十分に配慮して利用する必要があります。

田中 道昭

立教大学ビジネススクール教授。戦略コンサルタント。シカゴ大学MBA(企業戦略・ファイナンス・計量経済専攻)。専門は企業・産業・技術・金融・経済等の戦略分析。日米欧の金融機関に長年勤務。テレビ東京「ワールド・ビジネス・サテライト」コメンテーター。テレビ朝日「ワイドスクランブル」月曜レギュラーコメンテーター。公正取引委員会独禁法懇話会メンバー等兼務。

主な著書に『GAFA×BATH』(日本経済新聞出版)、『アマゾンが描く2022年の世界』(PHP研究所)、『モデルナはなぜ3日でワクチンをつくれたのか』(集英社インターナショナル)『経営戦略4.0図鑑』(SBクリエイティブ)、『GAFAM+テスラ 帝国の存亡』(翔泳社)ほか多数。