独立行政法人情報処理推進機構(IPA)は5月30日、IPAテクニカルウォッチとして「米国におけるAIのセキュリティ脅威・リスクの認知調査レポート」を公開した。概要(日本語)と本文(英語)英語全文をダウンロードすることが可能。

売上規模別に見た 全 IT 投資中のセキュリティ予算比率 ~ 東証上場企業

同レポートは、AIサービスの普及が加速度的に進む中で、AIのセキュリティ脅威がどう認知されているかを把握することを目的に、米国におけるAIに関するセキュリティ脅威とその認知に関する調査を実施したもの。

調査期間は2024年1月~2月、80以上の関連文献を調査し重要文献10件を抽出、AI・サイバーセキュリティ・行政・法務等のさまざまな領域の専門家10名のインタビューにより調査している。これらにより、「セキュリティ脅威の5つの類型における脅威と認知状況の実態」「各分野のリスクの大きさ(時期・影響度)に関するマップ」を分析した。

レポート(概要)の内容は次の通り。

1:AI利用の実態

2:AIで強化された従来のサイバー攻撃

3:AIを利用した虚偽情報

4:AIによるシステム障害とAIシステムへの攻撃

5:AIによる国家安全保障上のリスク

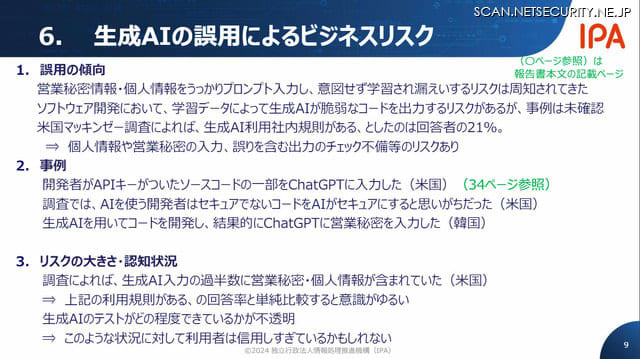

6:生成AIの誤用によるビジネスリスク

概要によると、AIにより既存の攻撃を素早く強力かつ効率的に行う傾向がみられる。特にAIフィッシングの急増・高度化、組織へのAIによる執拗な攻撃は観測されており、大きなリスクと認識している。一方で、AIを用いた新たな攻撃手法はまだ確認されておらず、高度な攻撃・マルウェア自動生成といった脅威が大きくなるには時間があるとしている。

AIを利用した虚偽情報は、言語や文化などの壁がなくなることで海外国家支援アクターからの攻撃が懸念される。すでに、悪意の生成AIモデルは2021年から出現している。実際に、有名人のフェイク画像による中傷は当たり前となり、フェイクの事故画像による株価の乱高下、選挙候補の中傷・選挙妨害にも生成AIが使われた可能性がある。

生成AIの誤用によるビジネスリスクでは、営業秘密情報・個人情報が漏えいするリスクは周知されているが、ソフトウェア開発において生成AIが脆弱なコードを出力するリスクも指摘している。なお、米国マッキンゼー調査によれば「生成AI利用社内規則がある」との回答は全体の21%だったという。