by 三柳 英樹

NRIセキュアテクノロジーズ株式会社(以下、NRIセキュア)は19日、「AIセキュリティ統制支援サービス」のラインアップの一つとして、生成AIを活用したシステムを対象にセキュリティ監視を行う「AI Blue Team」を提供開始した。

AI Blue Teamは、AI固有のリスクから企業を守るセキュリティ監視サービス。生成AI、特にLLM(大規模言語モデル)を情報システムに組み込んで業務効率化や新規サービスに活用する動きが急速に広がる中で、それらについてのセキュリティ対策がますます重要になっていると説明。LLMは、「プロンプトインジェクション」「プロンプトリーキング」などの攻撃の標的となりうる脆弱性のほか、「ハルシネーション」「不適切なコンテンツの生成」「バイアスリスク」などの生成内容の信ぴょう性の観点や、予期せぬ「機微情報の漏えい」といったインシデントなど、多岐にわたるセキュリティリスクをはらんでいるとしている。

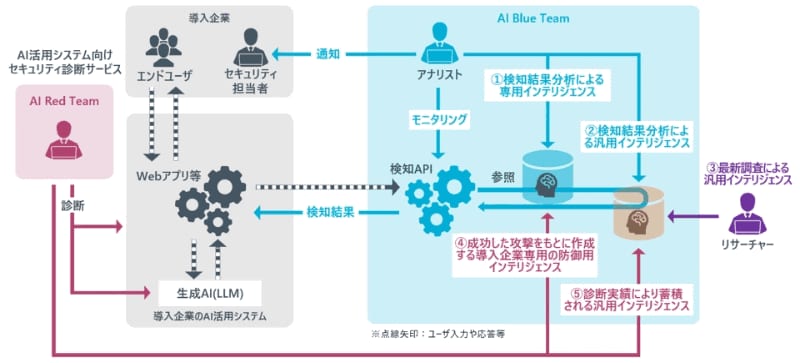

NRIセキュアでは、こうした生成AI(LLM)を取り巻くリスクを的確に検知することに加え、新種の攻撃手法やシステムの運用開始後に検出された脆弱性に対処するため、関連情報を「インテリジェンス(セキュリティ脅威について収集・分析した情報などの総称)」として継続的に蓄積し、監視業務に適用していくことを重視していると説明。LLMに関連するリスクから導入企業のシステムを保護する仕組みを独自に開発し、アプリケーションとしてAI Blue Teamに組み込んだとしている。

監視対象となるシステムと生成AI間で行われる入出力の情報を、サービスで提供する「検知API」に連携し、有害な入出力を検知した場合、導入企業の担当者に通知する。LLMが抱えるセキュリティリスクのモニタリングと対応に留まらず、NRIセキュアのアナリストが検知結果をもとに攻撃傾向を分析し、新種の攻撃手法等にも対応できるようにインテリジェンスを蓄積し、継続的に最新化する。アナリストがモニタリングする監視用画面は、導入企業の担当者もアクセスできるため、検知状況を直接確認できる。

AI Blue Teamの導入にあたっては、生成AIを利用するシステムやサービスを対象に、疑似攻撃を行うことで脆弱性や問題点を評価するセキュリティ診断サービス「AI Red Team」によるセキュリティ診断を実施する。サービスでは、AI Red Teamのセキュリティ診断で検出されたシステム固有の脆弱性にも対応できるよう、汎用的なインテリジェンスとは別に、導入企業専用のインテリジェンスを蓄積する。これにより、固有の脆弱性を攻撃から防御しつつ、システム全体の保護レベルを一層強化することが期待できるとしている。