by 松本 和大

グーグル(Google)は、AIの新たなオープンモデルとして「Gemma 2」の提供を開始した。研究者や開発者向けに提供され、Google AI Studioで利用できる。

Gemmaは、生成AI「Gemini」と同じ研究や技術から開発された、軽量なオープンモデルとなっている。

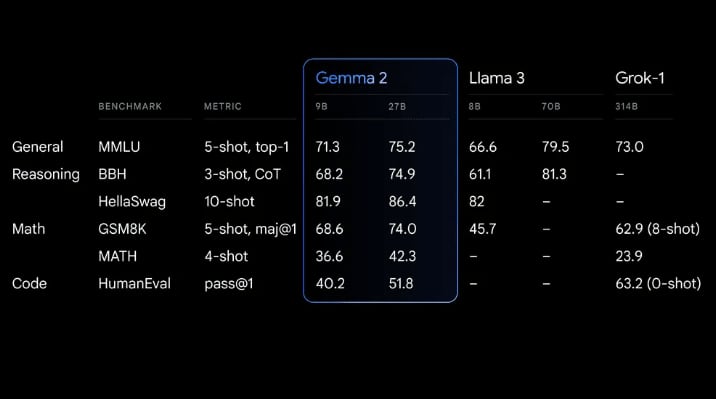

今回発表されたGemma 2は、90億(9B)と270億(27B)のパラメータサイズに対応する。第1世代にあたる「Gemma」よりも高性能で推論効率が高く、安全性も向上したという。

27BのGemma 2は、同等サイズでは最高クラスのパフォーマンスを発揮し、2倍以上のサイズのモデルに匹敵する。9BのGemma 2のパフォーマンスは、メタ(Meta)の「Llama 3」(8B)やほかのオープンモデルを上回るとアピールされている。

27BのGemma 2は、Google Cloud TPUホスト、NVIDIA A100 80GB Tensor Core GPUまたはNVIDIA H100 Tensor Core GPUのいずれかひとつで、完全な精度での推論を効率的に実行するよう設計されている。これにより、導入コストを削減する。

近日中には、より軽量なモデルとして2.6BパラメータのGemma 2も公開される予定。